728x90

"'괴물 AI칩' 들고 돌아온 엔비디아에"…삼성·SK, HBM 수혜 기대감 '껑충'

전 세계 인공지능(AI) 칩 시장을 주도하고 있는 엔비디아가

차세대 그래픽처리장치(GPU) 신제품을 대거 공개한 가운데

업계에선 고대역폭메모리(HBM) 분야에서 기술 경쟁력을 확보한 국내 반도체 업체들이 수혜를 볼 것이라는 기대감이 커지고 있다.

특히 AI 열풍으로 올해 HBM 생산량이 2배 이상 늘어날 것이라는 전망도 제기되고 있어 이를 둘러싼 메모리업체간 경쟁도 치열해질 것으로 예측된다.

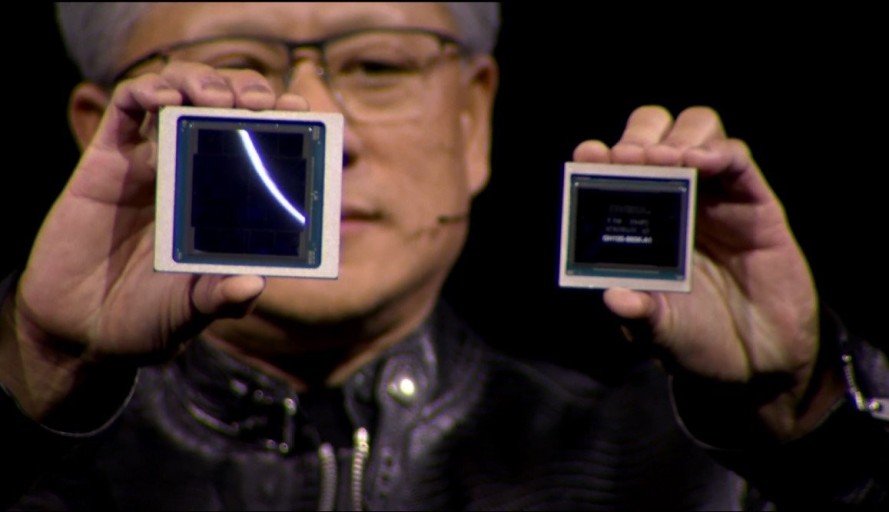

미국 반도체 기업 엔비디아는 18일(현지시간) 미국 캘리포니아 주 새너제이에서 열린

'GTC 2024'에서 새로운 GPU '블랙웰'을 기반으로 한 차세대 AI 칩 'B100'을 공개했다.

'블랙웰'은 엔비디아가 2년 전 출시한 호퍼 아키텍처의 후속 기술로,

'B100'은 현존하는 최신 AI 칩으로 평가받는 엔비디아 H100의 성능을 뛰어넘는 차세대 AI 칩이다.

아울러 '블랙웰'이란 이름은 게임 이론과 통계학을 전공한

수학자이자 흑인으로는 최초로 미국국립과학원에 입회한

데이비드 헤롤드 블랙웰을 기리기 위해 붙인 이름이다.

\

'블랙웰'은 역대 GPU 중 최대 크기로 2080억개의 트랜지스터로 구성됐다.

현존하는 기술로는 이 정도 규모의 트랜지스터를 넣을 수 없는데

엔비디아는 이를 실현하기 위해

2개의 GPU를 하나로 연결했다.

기존 H100과 비교하면 트랜지스터 수가 2.6배 늘어났다.

성능이 대폭 향상된 만큼 탑재되는 메모리 반도체 역시 많아졌다.

'B200'에는 5세대 HBM인 HBM3E가 8개 탑재된다.

전작인 H100과 H200에는 HBM이 각각 4개, 6개가 탑재됐는데 이보다 더 많은 것이다.

HBM은 여러 개의 D램을 수직으로 연결해 데이터 처리 속도를 혁신적으로 끌어올린 반도체로,

GPU 등 AI용 반도체에 필수적으로 사용된다.

엔비디아의 새로운 칩은 올해 말 본격 출시될 예정이다.

삼성전자 역시 엔비디아 제품 공급을 노리고 있다.

앞서 삼성전자는 지난달 세계 최초로 HBM3E 12단 제품 개발에 성공했다며 상반기 내 양산을 시작할 것이라고 밝혔다.

12단 HBM3E는 현존 최대 용량인 36GB로,

기존 8단 HBM3과 비교해 성능과 용량이 크게 향상된 제품이다.

특히 이번 엔비디아 GTC에서 삼성전자는 외부에 처음으로 신제품을 전시 및 공개했다.

AI 시장 확대로 HBM 시장은 올해 더욱 확대될 전망이다.

결론 : 고성능 파운드리 만들수 있는 회사는 삼성전자와 TSMC뿐

자료출처 : 아이뉴스

728x90

반응형

'주식 > 주식부동산' 카테고리의 다른 글

| 삼성전자, ARM, 빅딜 가능성 (2) | 2022.09.22 |

|---|---|

| 이재용 부회장 '광복절 특사'에 포함 될듯 (9) | 2022.07.13 |

| 트와이스 '전원 재계약' 마의 7년 깨고 화려한 2막 (6) | 2022.07.12 |

| 방탄소년단의 아름다운 서사는 계속된다 (7) | 2022.07.10 |

| '반도체 겨울' 전망에도 웨이퍼업계는 증설 경쟁..이유는? (6) | 2022.07.10 |